En la Era de la Velocidad, diez días pueden ser un mundo. Especialmente en el ámbito de la inteligencia artificial generativa (IAG), donde casi de forma semanal asistimos a un hito que nos deja, si aún se puede seguir usando esa palabra, boquiabiertos. Una evolución en la creación de imágenes, un avance en la generación de videos… todo se sucede a una rapidez vertiginosa, asfixiante incluso para el usuario más ávido de nuevas experiencias.

El que antes era el hermano pequeño y excéntrico en la carrera por esta tecnología se ha convertido de repente en el líder

El que antes era el hermano pequeño y excéntrico en la carrera por esta tecnología se ha convertido de repente en el líder

En la Era de la Velocidad, diez días pueden ser un mundo. Especialmente en el ámbito de la inteligencia artificial generativa (IAG), donde casi de forma semanal asistimos a un hito que nos deja, si aún se puede seguir usando esa palabra, boquiabiertos. Una evolución en la creación de imágenes, un avance en la generación de videos… todo se sucede a una rapidez vertiginosa, asfixiante incluso para el usuario más ávido de nuevas experiencias.

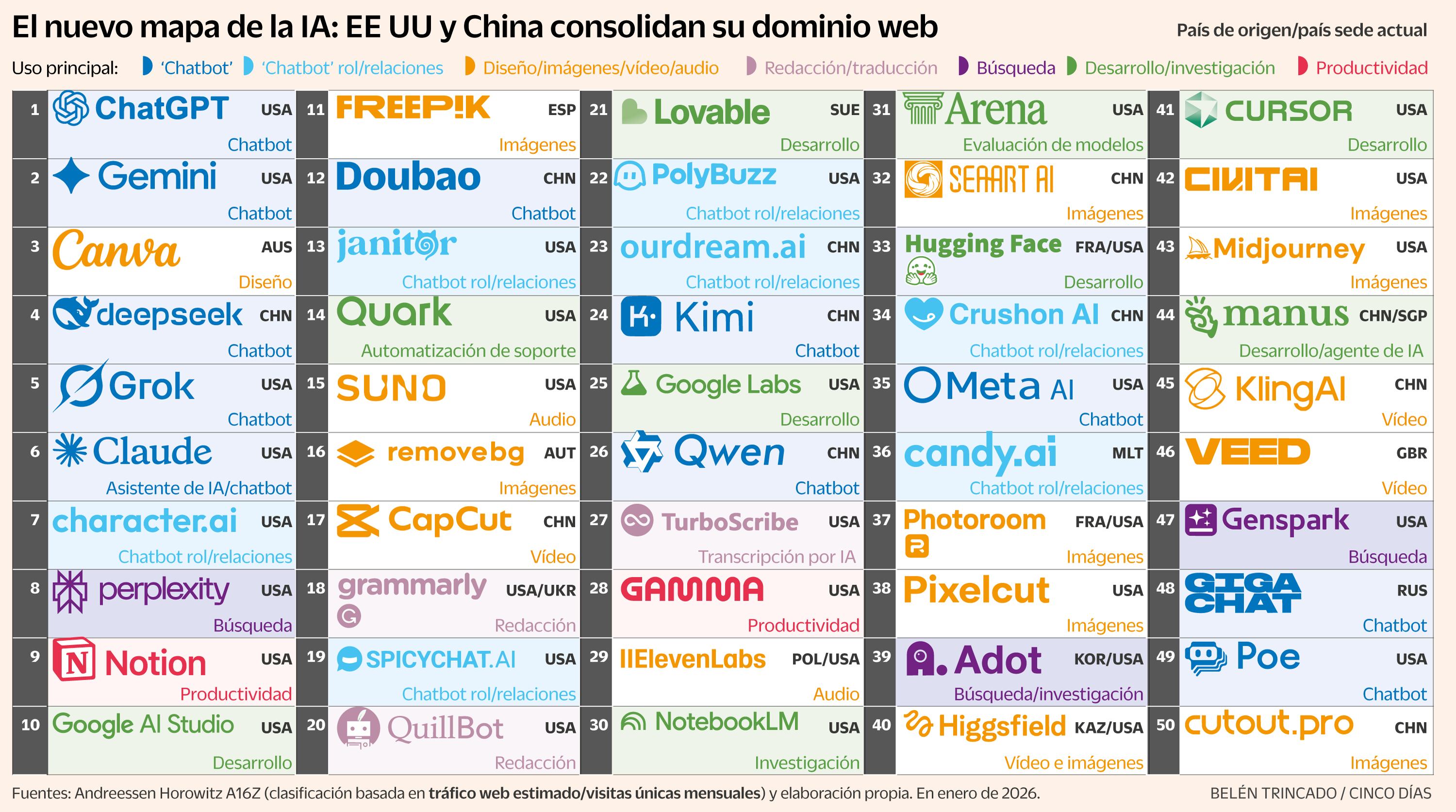

No en vano, estamos asistiendo aún a una lucha sin cuartel entre los distintos modelos generativos por hacerse con una mayor base de usuarios de IAG. ChatGPT fue el primero, pero no tiene por qué ser el definitivo. Google (Gemini) cuenta con fortaleza de marca y una integración casi de serie en nuestros teléfonos móviles. Claude, Perplejidad, DeepSeek, Grok… cada uno de ellos, con sus características, pugna por hacerse un hueco en un escenario donde nada está escrito.

Si empezamos a vislumbrar que Google ya no será la entrada casi exclusiva de acceso a internet para millones de personas en todo el mundo, entenderemos por qué para estos modelos afianzar ahora su cuota de usuarios es crucial. La IAG mejora con su uso, ya que va conociendo a la persona que la maneja, ajustándose a sus gustos, sus preferencias y su estilo.

Por eso, lo normal es que, tras una época de pruebas en las que investiguemos en los distintos modelos generativos, acabemos por elegir uno como nuestra herramienta de confianza, el que nos ayudará en nuestro día a día personal y profesional.

Diez días de retraso en lanzar un nuevo modelo. En ese punto estamos. En un momento en el que ser el primero en lanzar una ventaja competitiva puede servirte para captar millones de clientes que, presumiblemente, sean cautivos durante la próxima década. La mayor parte de los usuarios continuarán utilizando aquel modelo que aprendan a usar primero. Y es ahora cuando se están tomando esas decisiones.

Por eso sorprende tanto lo que pasó, hace cosa de un mes, en un hotel en Santa Clara (California). Cinco miembros de la empresa de IA Anthropic se apiñaban alrededor de un ordenador portátil, trabajando con urgencia. Se encontraban en una conferencia cercana cuando recibieron una noticia inquietante: los resultados de un ensayo controlado habían indicado que una versión de Claude, el sistema de IA de Anthropic, podría ayudar a los terroristas a fabricar armas biológicas.

Corrieron de vuelta a la habitación del hotel, volcaron una cama para usarla como escritorio improvisado y examinaron minuciosamente los resultados de las pruebas. Tras horas de trabajo, seguían sin estar seguros de si el nuevo producto era seguro. Anthropic acabó retrasando el lanzamiento del nuevo modelo, conocido como Claude 3.7 Sonnet, durante 10 días hasta estar seguros.

Parece un tema menor, pero es un enfoque revolucionario en Silicon Valley. Anteponer la ética a los beneficios empresariales. Algo que ha conducido a Anthropic a chocar frontalmente con el Gobierno de Donald Trump. Durante más de un año, Claude fue el modelo de IA preferido por el Gobierno de Estados Unidos y el primer sistema de vanguardia autorizado para uso clasificado. En enero se utilizó en la captura del presidente venezolano Nicolás Maduro en Caracas.

Pero, en las semanas siguientes, la relación entre Anthropic y el Pentágono se deterioró. El 27 de febrero, la Administración Trump anunció que designaría la empresa como un riesgo para la seguridad nacional en la cadena de suministro. Es la primera vez que se tiene constancia de que EE UU haya impuesto esa etiqueta a una empresa estadounidense.

Pete Hegseth, secretario de Defensa, anunció que cualquier empresa que hiciera negocios con el compañía tendría prohibido hacer negocios con Anthropic. Pero esta no cedió: mantuvo que se aferraba a sus valores, incluso cuando estos suponían un gran coste para la firma.

En realidad, Dario Amodei, CEO de la compañía, solo había puesto dos condiciones: no quería que la inteligencia artificial se utilizara en sistemas de armas totalmente autónomos, ni para llevar a cabo una vigilancia masiva de los ciudadanos estadounidenses. Pero fue suficiente. Hegseth y sus asesores se indignaron ante lo que consideraban un intento de una empresa privada de dictar al ejército cómo debía librar una guerra.

Y, sin embargo, los usuarios de la IAG han recompensado a la empresa por adoptar una postura ética, abandonando ChatGPT y acudiendo en masa a Claude. Ahora la empresa tiene que capear los próximos tres años bajo una Administración hostil, pero con el beneplácito del mercado.

Y es que el que antes era el hermano pequeño y excéntrico en la carrera por la inteligencia artificial se ha convertido de repente en el líder. Anthropic acababa de recaudar 30.000 millones de dólares de inversores de cara a una posible salida a Bolsa este año.

Su valoración, de 380.000 millones de dólares, ya eclipsa a las de Goldman Sachs, McDonald’s y Coca-Cola. Sus ingresos se disparan. En apenas unos años, esta empresa fundada por exinvestigadores de OpenAI ha pasado de presentarse como el laboratorio más “responsable” de la industria a convertirse, paradójicamente, en la compañía más disruptiva del mundo.

El crecimiento ha sido vertiginoso: en apenas un año, la proporción de empresas estadounidenses que pagan por sus herramientas pasó de alrededor del 4% al 20%, mientras se disparan los ingresos proyectados de la compañía.

Este crecimiento ha colocado Anthropic en el centro de la nueva economía de la inteligencia artificial. Su estrategia se basa en dos pilares: modelos extremadamente potentes y una narrativa ética que intenta diferenciarse del resto de la industria. En un sector donde las compañías suelen competir por demostrar quién puede hacer más con la IA, Anthropic ha decidido competir también por quién pone límites.

Es el caso más mediático, pero no el único. Y marca el camino a seguir. Las compañías que antepongan la ética a los resultados serán las que dominen el siglo XXI.

Feed MRSS-S Noticias